AI 에이전트를 업무에 붙일 때 먼저 볼 것은 모델이 얼마나 똑똑한지가 아니라 어떤 행동 권한을 넘겨받는지다.

- 챗봇형 도움과 에이전트형 실행은 권한의 무게가 다르다.

- 고객 메시지, 비용 집행, 공식 기록 변경에 닿는 순간 승인 경계는 핵심 설계 문제가 된다.

- 판단 기준은 간단하다: 결과가 외부 시스템에 남거나 돈과 책임을 움직이면 사람의 승인선을 먼저 확인해야 한다.

- 운영 지표로는 실행 권한 범위, 승인 대기 비율, 수동 되돌림 가능 여부를 함께 봐야 한다.

AI 에이전트 운영의 출발점은 자동화 속도가 아니라, 무엇을 맡기고 어디서 멈출지 정하는 일이다.

AI 자동화를 검토하는 팀이라면 에이전트를 붙이기 전에 먼저 권한과 승인 경계를 봐야 한다. 답은 분명하다. 에이전트가 단순히 답을 제안하는 수준을 넘어 기록을 바꾸거나, 비용을 일으키거나, 고객에게 메시지를 보낼 수 있다면 성능보다 운영 경계가 먼저다.

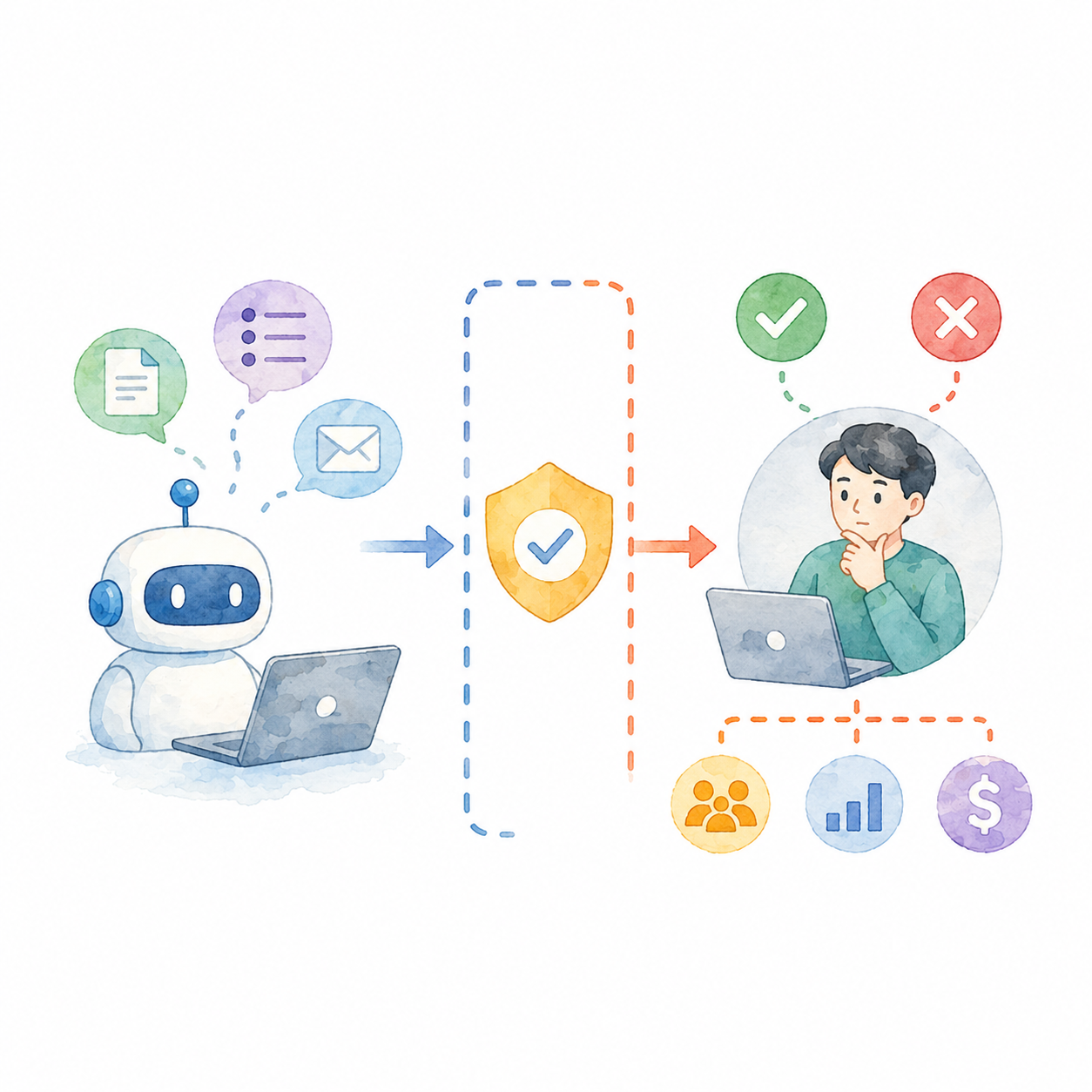

여기서 말하는 권한 위임(delegated permission)은 사람이 하던 일부 실행 권한을 시스템이 대신 쓰게 하는 것이다. 승인 경계(approval boundary)는 그 실행이 자동으로 넘어가도 되는지, 사람 확인을 거쳐야 하는지를 가르는 선이다. 이 선이 흐리면 좋은 자동화도 비용 사고나 책임 공백으로 읽힌다. 첫 판단은 에이전트가 만든 결과가 어디에 남는지 보는 것이다. 화면 안 조언으로 끝나면 품질 문제에 가깝고, 시스템 상태를 바꾸면 운영 책임 문제로 바뀐다.

에이전트는 답변 도구가 아니라 행동 경로가 될 수 있다

챗봇은 보통 질문에 답하거나 초안을 제안한다. 업무 자동화는 정해진 규칙에 따라 반복 작업을 처리한다. 에이전트형 실행은 여기서 한 걸음 더 가서 여러 도구를 호출하고, 다음 행동을 고르고, 업무 시스템에 흔적을 남길 수 있다. 이 차이가 권한 문제를 만든다.

명시적 가상 상황을 보자. 한 팀이 고객 문의 초안을 작성하는 에이전트를 도입했다면 위험은 낮다. 하지만 같은 에이전트가 CRM의 고객 등급을 바꾸고 환불 요청까지 전달할 수 있다면, 이제 문제는 문장 품질이 아니라 실행 권한이다. 답변이 조금 어색한 것과 공식 기록이 잘못 바뀌는 것은 운영상 같은 문제가 아니다.

다음처럼 먼저 구분하면 오판이 줄어든다.

| 사용 형태 | 주된 위험 | 먼저 볼 기준 |

|---|---|---|

| 답변 제안 | 품질 편차 | 사람이 최종 확인하는가 |

| 작업 준비 | 잘못된 입력 전파 | 승인 전 수정 가능성이 있는가 |

| 시스템 실행 | 비용·기록·고객 영향 | 실행 전 승인선과 되돌림 경로가 있는가 |

이 표에서 오른쪽으로 갈수록 먼저 볼 신호는 결과가 외부 시스템에 남는지, 되돌리기 쉬운지, 사람 책임이 어디에 붙는지다. 여기서 자연스럽게 남는 다음 질문은 작은 권한이 왜 연결 경로 안에서 더 큰 행동이 되는가다. 그 원인은 AI 에이전트 권한 문제는 어디서 먼저 흔들릴까에서 더 구체적으로 이어진다.

첫 판단 기준은 영향 범위다

권한을 볼 때 가장 쉬운 기준은 영향 범위다. 에이전트의 행동이 개인 메모 안에 머물면 위험은 제한적이다. 반대로 외부 고객, 비용, 접근 권한, 공식 기록에 영향을 주면 승인 경계가 반드시 필요하다. 이때 운영 지표는 모델 점수보다 실행 성공률, 승인 대기 비율, 되돌림 요청 건수, 수동 개입 횟수처럼 행동 이후에 남는 신호가 된다.

흔한 오해는 작은 권한이면 안전하다고 보는 것이다. 작은 권한도 여러 시스템과 연결되면 의미가 달라진다. 이메일 초안 작성은 낮은 위험이지만, 고객군 선택, 발송 예약, 할인 코드 적용이 함께 붙으면 고객 경험과 비용에 영향을 준다. 권한은 하나씩 볼 때보다 연결된 흐름으로 볼 때 더 정확하다.

판단 문장은 이렇게 잡을 수 있다. 에이전트가 바꾸는 것이 다시 고치기 어렵거나 외부 이해관계자에게 보이면, 자동 실행이 아니라 승인 후 실행으로 설계해야 한다. 반대로 사람이 항상 최종 버튼을 누르고 변경 내역이 명확히 남는다면, 낮은 위험 작업부터 시작할 수 있다.

큰 그림은 경계, 다음 질문은 원인과 통제다

권한과 승인 경계를 먼저 보라는 말은 모든 자동화를 막으라는 뜻이 아니다. 자동화를 안전하게 키우려면 어디까지 맡길 수 있는지 먼저 정해야 한다는 뜻이다. 좋은 에이전트 운영은 사람을 배제하는 방식이 아니라, 사람이 판단해야 할 지점을 더 분명하게 만드는 방식이다.

다음과 같은 if-then 기준을 두면 초기 판단이 빨라진다.

- If 에이전트가 내부 초안만 만든다면, then 품질 문제로 다룰 수 있는지 먼저 본다.

- If 에이전트가 업무 시스템 값을 바꾼다면, then 어떤 권한들이 하나의 행동 경로로 이어지는지 물어야 한다.

- If 에이전트가 고객, 비용, 접근 권한에 영향을 준다면, then 어디서 사람 판단을 남겨야 하는지가 다음 설계 질문이 된다.

이 큰 그림만으로는 충분하지 않다. 권한이 왜 흐려지는지 이해해야 잘못된 승인선을 피할 수 있고, 실제 운영 통제는 별도의 판단 기준으로 정리해야 한다. 그래서 다음 질문은 두 갈래다. 왜 작은 권한이 실제 업무 안에서 커지는지는 AI 에이전트 권한 문제는 어디서 먼저 흔들릴까에서, 그 권한을 어디서 멈추고 어떤 흔적을 남길지는 AI 에이전트 운영 통제는 무엇부터 설계해야 할까에서 이어서 보는 것이 자연스럽다.

FAQ

Q1. AI 에이전트가 답변만 만든다면 승인 경계가 필요 없나요?

A1. 답변만 만들고 사람이 최종 사용 여부를 결정한다면 승인 경계는 가볍게 둘 수 있다. 다만 답변이 고객 발송, 계약 문구, 비용 안내처럼 외부 결과로 이어지면 초안 단계라도 검수 기준과 책임자를 정해야 한다.

Q2. 자동화 도구와 AI 에이전트의 차이는 무엇으로 판단하면 되나요?

A2. 비교 기준은 행동 선택권이다. 정해진 규칙을 반복하면 자동화 도구에 가깝고, 여러 도구 중 무엇을 호출할지 고르고 업무 시스템에 결과를 남기면 에이전트 운영 문제로 봐야 한다.

Q3. 처음 도입할 때 가장 낮은 위험의 시작점은 무엇인가요?

A3. 공식 기록을 바꾸지 않고, 비용을 일으키지 않고, 고객에게 직접 발송하지 않는 작업이 낮은 위험 출발점이다. 관찰 가능한 신호로는 사람이 최종 승인하는 비율과 수동 수정이 필요한 빈도를 먼저 보면 된다.